Microsoft tester angivelig en mer selvstendig Copilot-agent i Microsoft 365. Hvis det stemmer, er dette mer enn en liten funksjonsoppdatering. Det er et tegn på at AI ikke bare skal svare på spørsmål, men begynne å utføre arbeid i bakgrunnen, med mer kontekst, mer kontinuitet og færre manuelle steg.

For bedrifter betyr det at grensen mellom assistent og medarbeider blir gradvis mer uklar.

Det viktige her er ikke bare at Microsoft tester noe mer avansert. Det viktige er hva slags arbeidsflyt de ser for seg. En agent som kan følge med, tolke kontekst, foreslå neste steg og utføre oppgaver, gjør Copilot langt mer enn en chatflate. Det blir en operativ lag-på-lag-løsning over e-post, møter, dokumenter og oppgaver.

Hva er det som angivelig testes?

Det som beskrives i dekningen1, er en mer “always-on” agent for Microsoft 365 Copilot. Ikke bare en modell du spør når du trenger hjelp, men en agent som kan ha bedre kontinuitet og mer aktiv rolle i arbeidsdagen.Det er verdt å merke seg at dette fortsatt er spekulativt på detaljnivå. Vi vet ikke nøyaktig hvordan funksjonen vil se ut i sluttproduktet. Men retningen er tydelig: AI blir mer proaktiv, mer spesialisert og mer integrert i arbeidsverktøyene folk allerede bruker.

For bedrifter er dette interessant av tre grunner

1. Mindre friksjon i hverdagen

Hvis agenten kan hente informasjon, foreslå handlinger og følge opp uten at brukeren må starte hver samtale på nytt, sparer man tid.

2. Mer arbeidsflyt, mindre prompt-arbeid

Dagens Copilot-bruk handler ofte om spørsmål og svar. Neste steg er arbeidsflyt: “gjør dette”, “følg opp det”, “oppsummer det”, “varsle meg når dette skjer”.

3. Større behov for kontroll og sikkerhet

Jo mer autonom AI blir, desto viktigere blir tilgangsstyring, logging, godkjenning og tydelige grenser.

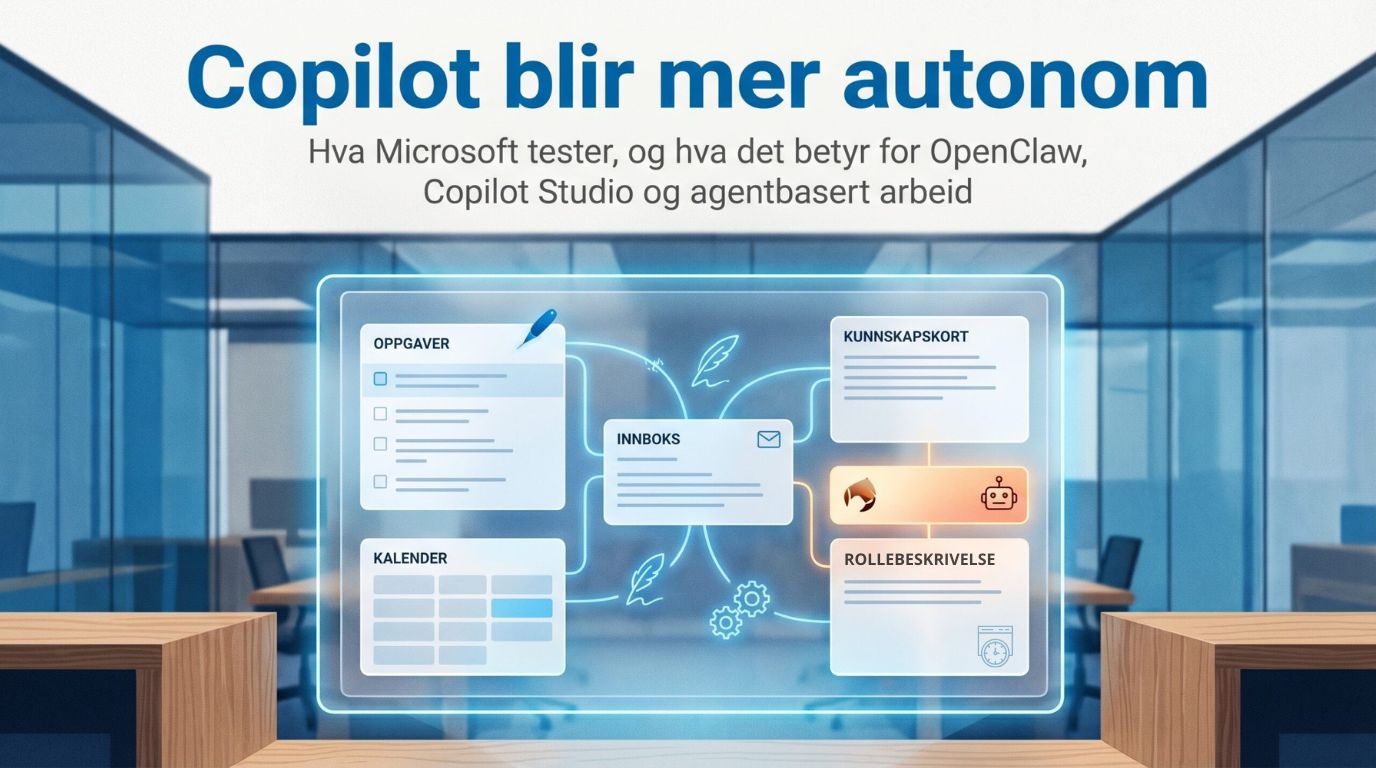

Denne illustrasjonen forklarer konseptet slik det i praksis ofte ser ut i dag: En autonom agent som leser fra kunnskapskilder, foreslår svar og sender videre til mennesker ved behov.

Et typisk eksempel kan være en autonom agent som fungerer som en digital sekretær som leser e-postene dine, forstår hva som krever handling, og organiserer møter ved å koordinere kalenderen din automatisk. Den prioriterer, foreslår svar og booker tidspunkt basert på kontekst, preferanser og tilgjengelighet – uten at du trenger å følge opp manuelt.

“Microsoft is exploring the potential of technologies like OpenClaw in an enterprise context.”

— Omar Shahine, Microsoft2

Det er kanskje ikke så overraskende. Spørsmålet er ikke om teknologien fungerer – det gjør den allerede – men hvordan enterprise-verdenen skal håndtere kontroll, governance og ansvar når agentene faktisk begynner å gjøre jobben.

Hva dette kan bety i Microsofts innpakning

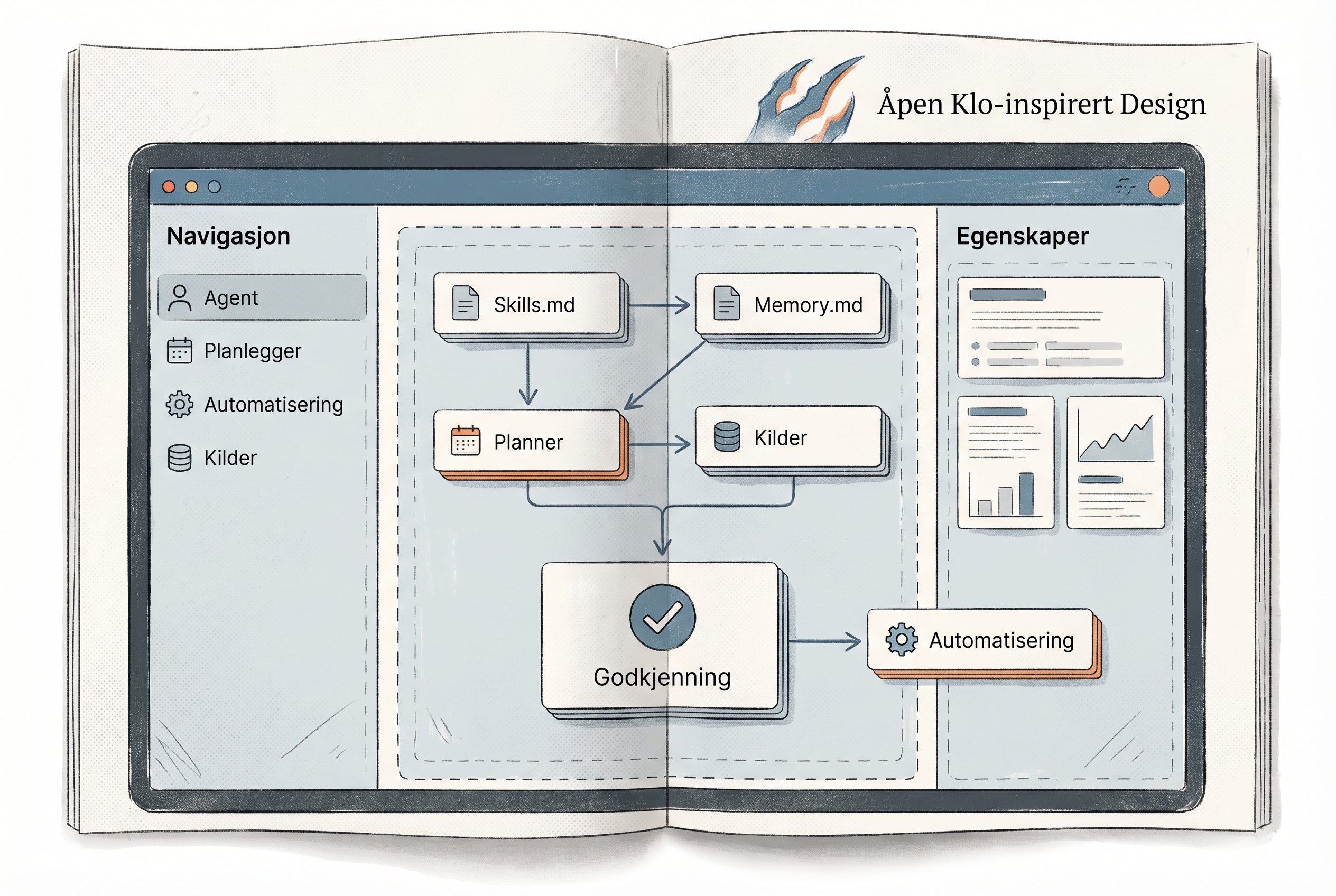

Denne illustrasjonen er bare en konseptskisse for hvordan et mulig Copilot-liknende grensesnitt kan se ut i praksis. Det viser at agentene ikke lever i et vakuum, men henger sammen med regler, kunnskapskilder, memory, skills og godkjenning, som vi kjenner fra Open Claw.

Hva kan dette bety for deg som bruker?

Hvis du jobber med Copilot, Copilot Studio eller agentbasert automatisering, er dette signalet verdifullt

- Det kommer mer agentisk funksjonalitet.

- Det blir mer fokus på kontinuerlige arbeidsflyter.

- Det blir viktigere å tenke på kontroll, sikkerhet og godkjenning.

- Brukere vil forvente at AI kan gjøre mer enn å skrive tekst.

Oppsummering

Det mest interessante med denne nyheten er ikke om én spesifikk funksjon faktisk kommer nøyaktig slik den beskrives. Det mest interessante er retningen: Microsoft, OpenAI og resten av markedet beveger seg mot AI som kan gjøre mer av arbeidet, ikke bare forklare det

For bedrifter er det både spennende og litt krevende. Gevinsten er høyere produktivitet. Kravet er bedre styring.

Fotnoter / kilder

- The Times of India, *Microsoft 365 Copilot may get AI agent that OpenAI CEO Sam Altman spent billions on ↩︎

- The Verge, dekning av Microsofts eksperimentering med mer autonome Copilot-agenter og uttalelse fra Omar Shahine. ↩︎